음성인식 기술의 등장

아마존 에코(Echo)의 등장 이후 다시 음성인식 기술에 대한 관심이 증가하고 있다. 그런데 과거 신문기사를 검색해보면, 재미있는 사실을 발견할 수 있다. 음성인식이라는 키워드는 이미 1980년대부터 등장하고 있었을 뿐만 아니라, 당시에도 음성인식 기술이 마치 곧 상용화될 것 같은 인상을 주고 있었다는 점이다.

음성인식 시스템 실용화 활발 (1986년, 매일경제)

"음성인식 컴퓨터" 곧 실용화 (1992년, 동아일보)

음성인식 PC 시판 (1993년, 경향신문)

이러한 음성인식 기술의 발전을 일반인들이 처음 제품으로 인식한 것은 20년 전쯤 되는 것 같다. 통신사업자 중에서는 1997년 SKT가 음성인식 부가서비스를 제공하기 시작했고, 휴대폰 제조업자 중에서도 1997년 대우통신, 1998년 현대전자가 음성인식이 가능한 기기를 개발했다.

물론 당시의 음성인식 기술은 이미 저장된 음성대로 다시 발음하면 그 음성을 인식하고, 거기에 따라 전화가 걸리는 수준이었다.

최근 음성인식 기술의 주요 상용화 분야

현재 음성인식 기능이 가장 활발하게 도입된 곳은 바로 콜센터로 추정된다. 미국에서는 이미 상당히 많은 콜센터에서 복잡하지 않은 질문들은 직원이 응대할 필요 없이 기계와의 음성 커뮤니케이션을 통해 처리되고 있다. 최근 몇 년 사이 우리나라에서도 이 분야에서 음성인식 기술 활용이 확산하고 있다.

AT&T 콜센터에 음성인식 기술... 실시간 속기록·고객감정 파악 (2014년, 연합뉴스)

KT DS, 콜센터 음성인식 솔루션 시장 진출 (2016년, ZDNet Korea)

콜센터 이외에도 미국에서 '구글 보이스'의 음성 인식기능은 이미 광범위하게 활용되고 있다. 이 지역 소비자들은 여전히 음성사서함(Voice Mail)을 활발히 사용하고 있는데, 여기에 음성인식 기능이 적용되고 있다. 최근에는 '구글보이스'의 음성-문자 전환(Voice to Text)기능을 활용해 음성사서함을 직접 확인하기보다 문자로 변환된 내용을 간편하게 확인한다.

음성인식과 인공지능의 만남

하지만, 일반인들에게 가장 잘 알려진 음성인식 기능의 대표주자는 개인비서 서비스로 알려진 애플의 '시리', 그리고 구글의 '구글나우', MS의 '코타나' 3개 정도다.

특히 '시리'와 '구글나우'는 스마트폰에 탑재되어 이미 많은 사람이 한 번 이상은 경험해 보았고, '코타나'도 윈도 기반의 컴퓨터를 쓰는 사람들은 누구나 가지고 있다. 이처럼 최근에는 음성인식 기술과 인공지능과의 교집합의 분야에 집중적인 투자가 이루어지고 있다.

이번에는 이들 3개 서비스 이외에 어떤 인공지능 기반의 음성인식 기술들이 존재하는지 살펴보았다.

아마존의 에코(Echo)와 알렉사(Alexa)

20년 전 음성인식 기술과의 기술적 차이와는 별개로, 현재의 음성인식은 소비자들에게 20년 전 음성인식 기술 이상의 가치를 주지는 못하고 있었다. 이에 따라 여전히 소비자 대부분은 음성인식을 재미있는 부가기능 정도로만 생각해왔다.

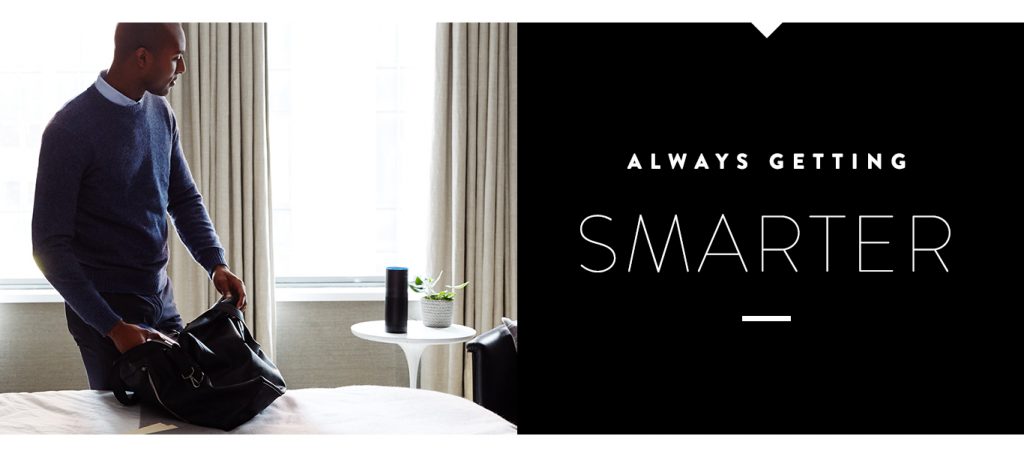

그런 측면에서 2014년 처음 시장에 등장한 아마존의 '에코'는 음성인식 기술을 기반으로 일반인에게 구매할만한 가치를 부여한 최초의 상품으로 평가할 수 있다.

아마존의 '에코'는 음성인식 기술과 스피커를 결합해 스포티파이(Spotify), 판도라(Pandora) 등을 통해 음악을 들려주고, 오디오 북을 들려줄 뿐만 아니라, 뉴스나 교통 상황이나 날씨, 스포츠 뉴스 등을 사용자에게 알려준다. 그뿐만 아니라 위모(WeMo), 필립스 휴(Philips Hue), 삼성 스마트씽즈(Samsung SmartThings), 네스트(Nest) 등과 연계된 서비스를 제공하기도 한다.

'에코'는 아직 완성도 높은 가상비서 수준에 도달하지는 못했지만, 최소한 라디오의 대체재로는 충분한 것으로 보인다. 현재 아마존에서는 '아마존 에코(Amazon Echo)'와 '아마존 탭(Amazon Tap)', '에코 닷(Echo Dot)'의 세 가지 제품을 판매하고 있다.

이에 따라 메신저 앱인 '로저(Roger)'는 앱 내에서 알렉사 기능 대부분을 무료로 활용할 수 있도록 지원하고 있으며, 이외에도 냉장고 자석 형태로 라디오와 메모 등의 기능을 제공하는 '트리비(Triby)' 등 다양한 아이템들이 등장하고 있다.

인공지능 엔진 뮤즈(Muse)를 탑재한 영어교육 로봇 뮤지오(Musio)

기존의 음성인식 서비스의 근본적인 문제는 기존의 대화를 기억하지 못한다는 점에 있었다. 사용자들은 항상 처음 만나는 친구를 대하듯이 '시리'나 '구글 나우'에 음성명령을 내려야 했다.

물론 주요 음성인식 서비스들도 최근에는 사용자의 기존 명령이나 개인정보를 활용하는 기능을 갖추어가고 있다. MS의 코타나는 이 분야에서 시리나 구글나우에 앞서는 것으로 평가되고 있는데, '노트북'을 통해 사용자의 정보를 기록하고 그다음 명령에 참고하는 기능이 바로 그것이다.

국내 업체인 아카스터디가 개발한 '뮤지오(Musio)'는 인공지능 엔진 '뮤즈(Muse)'를 통해 기존의 대화 내용을 반영한 새로운 커뮤니케이션을 시도하고 있다. 이를 통해 특히 영어 교육에 특화된 기능을 제공할 계획이다.

비브랩스(Viv Labs)의 비브(Viv)

'시리'를 개발한 엔지니어들이 애플 인수 이후 다시 독립해 2014년경부터 다시 개발하기 시작한 음성인식 서비스가 바로 '비브(Viv)'다.

'비브'는 일상 대화의 형태인 복합적 질문을 인식할 수 있다. 워싱턴 포스트에 의하면, 예를 들어 "동생 집으로 가는 길에 라자냐와 이에 맞는 저렴한 와인을 구입하고 싶다"고 하면, 동생 집까지 가는 경로와 이 경로에 있는 와이너리 목록, 라자냐를 살 수 있는 가게를 표시해준다고 한다.

사운드하운드(SoundHound)의 하운드(Hound)

음악 검색 서비스 '사운드하운드(SoundHound)'로 유명한 사운드 하운드(SoundHound Inc.) 역시 하운드(Hound)라는 음성 인식 서비스를 제공하고 있다. '하운드'의 특징은 데이터의 실시간 처리에 있다.

예를 들면, 아마존의 알렉사 기반 '로저(Roger)'는 음성명령이 끝난 이후 실행되어 지연되는 시간이 발생하는 반면에 '하운드'는 음성인식과 동시에 실행되기 때문에 업무 처리 속도가 훨씬 빠를 뿐만 아니라 복잡한 문장도 처리할 수 있다.

클래러티 랩(Clarity Lab)의 루시다(Lucida)

루시다(Lucida)는 미시간 대학 연구소인 클래러티 랩(Clarity Lab)이 개발하고 있는 리눅스 기반의 음성인식 기술이다. 클래러티 랩이 개발한 서비스의 이름을 애플의 시리와 비슷한 시리우스(Sirius)에서 최근 루시다(Lucida)로 명칭을 변경했다.

'시리우스'의 홈페이지에는 "Sirius is not produced by Apple and in no way derived from Apple's Siri."라는 문구를 통해 애플의 '시리'와 별개의 것이라는 것을 강조하고 있다.

'루시다'의 가장 특징적인 부분은 바로 오픈소스라는 점이다. 라이선스는 'BSD 라이선스'를 따르며, 이를 지키는 한도에서 누구나 무료로 활용할 수 있다. '루시다' 자체도 리눅스를 포함한 다양한 오픈소스를 활용해 개발되고 있다.